Content-Qualität ist zu einem zentralen Wettbewerbsfaktor geworden, seit Suchanfragen zunehmend von KI‑gestützten Systemen beantwortet werden. Anbieter wie Google, OpenAI‑Modelle und Tools wie Perplexity wählen Antworten nicht mehr nur nach klassischen Ranking‑Signalen, sondern nach Verständlichkeit, Kontext und Informationsqualität. Dieser Wandel zwingt Redaktionen und Unternehmen, Inhalte so aufzubauen, dass sie sowohl von Menschen als auch von Maschinen korrekt interpretiert und zitiert werden.

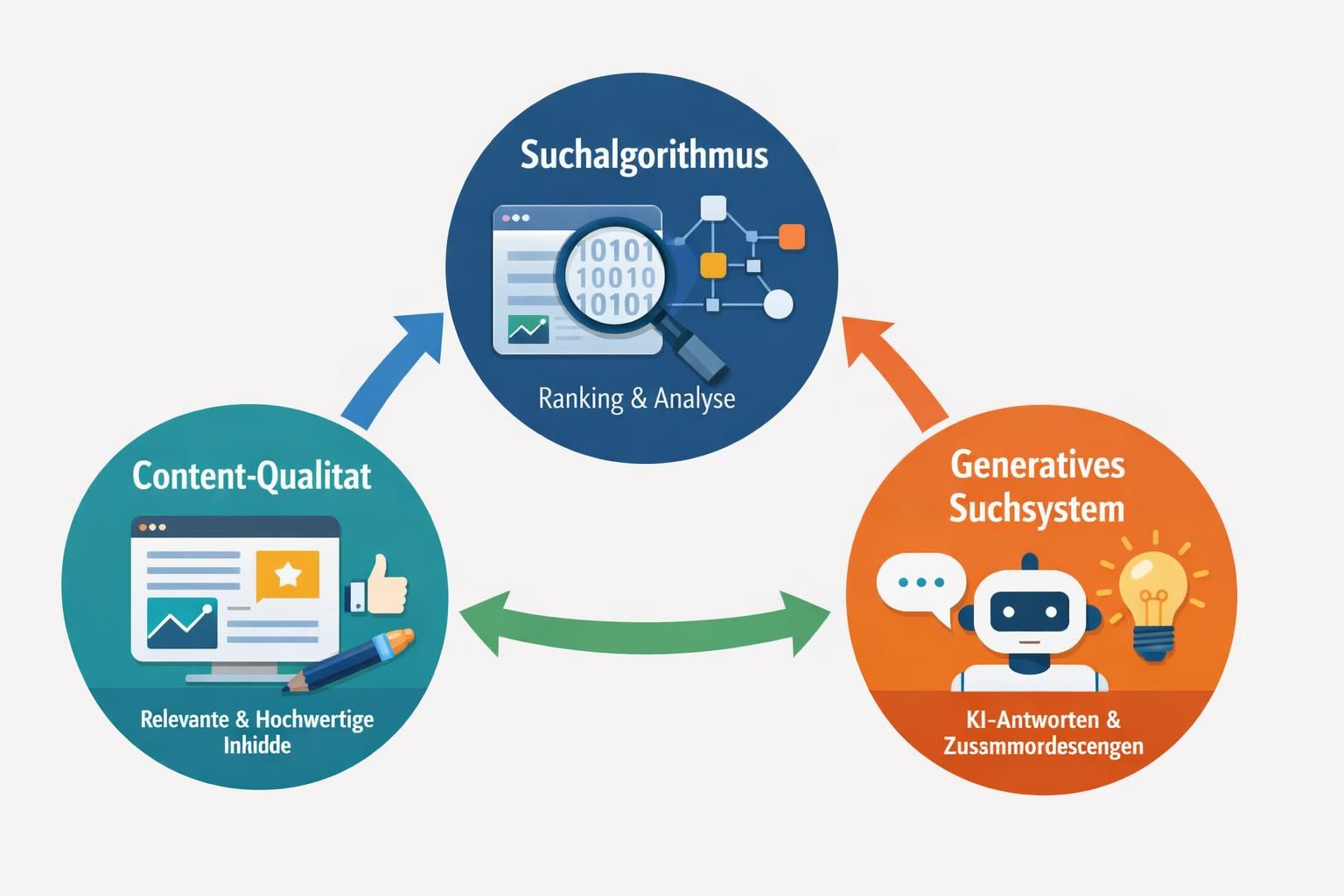

Wie Content-Qualität generative Suchsysteme und Suchalgorithmus beeinflusst

Signale, die Antworten steuern: Verständlichkeit, Kontext und Inhaltsanalyse

Moderne Systeme arbeiten mit mehreren Auswahlmechanismen: trainingsbasierte LLMs, suchbasierte Engines wie Google Gemini und hybride Modelle kombinieren Maschinelles Lernen mit Echtzeit‑Abruf. Entscheidend sind dabei klare Themen, konsistente Begriffe und explizite Kontextualisierung, damit eine Inhaltsanalyse durch die Engine gelingt.

Generative Systeme priorisieren Inhalte mit hoher Informationsqualität, nachvollziehbarer Argumentation und sauberer Quellenangabe. Forschung und Praxis zeigen, dass Seiten mit klar definierter thematischer Autorität eher als zitierfähige Quellen auftauchen; dazu gibt es vertiefende Analysen zur thematischen Autorität und Seitenrankings. Wer diese Signale nicht sendet, riskiert, in KI‑Antworten unberücksichtigt zu bleiben.

Insight: Ein Suchalgorithmus bewertet Inhalte zunehmend danach, ob sie sich eindeutig extrahieren und als vertrauenswürdige Informationsquelle verwenden lassen.

Praktische Prinzipien für bessere Suchergebnisse und Benutzererfahrung

Struktur, Datenvalidierung und Relevanzbewertung in redaktioneller Praxis

Gute Inhalte folgen einfachen Regeln: klare Sätze, eine eindeutige Themenzuweisung und konsistente Terminologie. Solche Texte erleichtern die automatische Datenvalidierung und erhöhen die Chance, in einer generativen Antwort zitiert zu werden.

Technisch unterstützen Schema‑Markups und gepflegte Knowledge‑Graph‑Einträge die Auffindbarkeit. Redaktionen sollten außerdem Quellen und Zitate so einbauen, dass KI‑Modelle die Herkunft von Fakten nachvollziehen können; dies stärkt die Relevanzbewertung und die Glaubwürdigkeit der Antwort.

Insight: Nutzer erwarten nicht nur schnelle Antworten, sondern auch nachvollziehbare Quellen — das beeinflusst direkt die Benutzererfahrung und Vertrauen in KI‑Antworten.

GEO vs. SEO: Strategien für Unternehmen im Umgang mit generativen Suchsystemen

Audit, Engine-spezifische Anpassung und Messbarkeit

Generative Engine Optimization (GEO) erweitert klassische SEO: Neben Keywords und Backlinks zählt jetzt die Extrapolierbarkeit von Inhalten für KI‑Antworten. Ein Content‑Audit prüft, ob Texte klar strukturiert, aktuell und zitierfähig sind.

Unternehmen müssen Engine‑Prioritäten setzen — Google SGE, Gemini, ChatGPT oder Perplexity verlangen unterschiedliche Formate und Aktualitätsanforderungen. Monitoring‑Metriken verändern sich: Im Fokus stehen Impressionen in AI‑Overviews, Zitationsrate und qualitative Nutzerrückmeldungen statt nur klassische Rankings.

Gleichzeitig bleiben Grenzen bestehen: Messbarkeit ist schwieriger, und Vertrauen in KI‑Antworten muss redaktionell erarbeitet werden. Agilität und laufende Anpassung sind daher Pflicht, kein einmaliges Projekt.

Insight: GEO ist kein Ersatz für SEO, sondern eine Ergänzung — wer beide Disziplinen integriert, sichert Sichtbarkeit in der neuen Suchrealität.

Kurz gefasst: Die Qualität und Struktur von Inhalten entscheidet heute darüber, ob sie in generativen Antworten erscheinen oder nicht. Unternehmen, die Content-Qualität, Inhaltsanalyse und Informationsqualität systematisch verbessern, erhöhen ihre Chancen, in der KI‑getriebenen Suche langfristig sichtbar zu bleiben.